Manejo globalpetsitter.com. Conectando dueños de mascotas con cuidadores alrededor del mundo. Como cualquier startup necesito contenido promocional, específicamente anuncios en video para redes sociales. El problema es que hacer incluso un simple anuncio de 30 segundos toma una eternidad

El Problema

Cada vez que quería hacer un anuncio en video el proceso era algo así:

- Escribir un guión o storyboard

- Encontrar o crear imágenes para cada escena

- Generar o grabar la voz en off

- Convertir imágenes en clips de video con movimiento

- Sincronizar audio con video

- Editar todo junto en capcut

Cada paso necesita herramientas diferentes, logins diferentes, un montón de cambio de contexto. Para un anuncio de 6 escenas estamos hablando de horas. ¿Y si no me gustaba el resultado? Empezar de nuevo

Ad Forge

Construí ad forge para colapsar todo esto en un solo pipeline. Describe tu anuncio en texto plano, deja que la ia haga el trabajo pesado

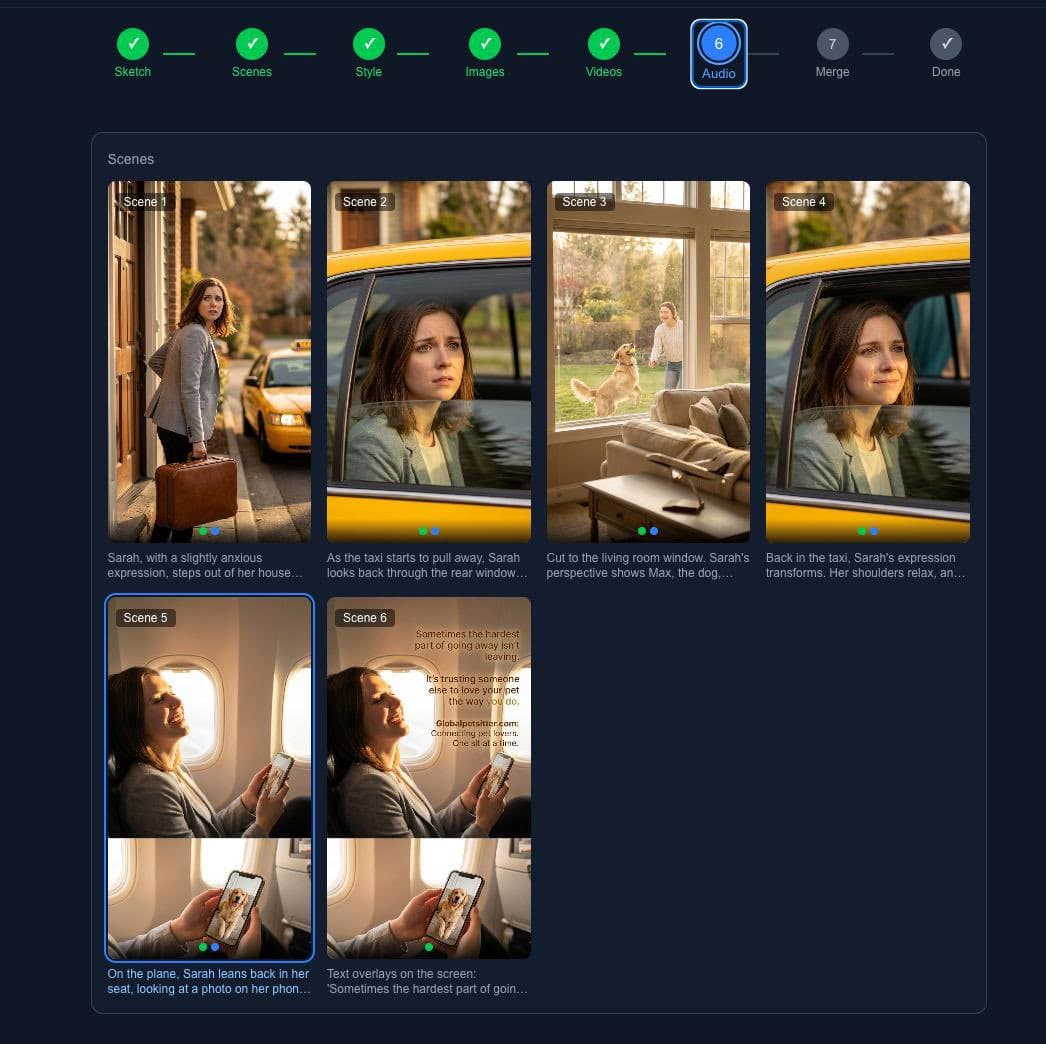

Así se ve el resultado:

Cómo Funciona

7 etapas:

1. Boceto - describe el concepto de tu anuncio, audiencia objetivo, tono, duración. Para el anuncio de globalpetsitter escribí algo como "mujer saliendo de viaje, preocupada por su mascota, luego sintiéndose aliviada sabiendo que está cuidada"

2. Escenas - gemini descompone tu boceto en escenas individuales con descripciones, escenarios, estado de ánimo, duraciones sugeridas. Estructura el arco narrativo automáticamente

3. Estilo - la ia genera una guía de estilo. Paleta de colores, iluminación, mood visual, descripciones de personajes, detalles de locaciones. Mantiene todo visualmente consistente

4. Imágenes - fal.ai genera una imagen para cada escena. El sistema usa imágenes de referencia de escenas anteriores y retratos de personajes para mantener la consistencia. Esta fue la parte más difícil de lograr

5. Videos - cada imagen se convierte en un clip de video con movimiento de cámara (paneo, zoom, dolly, etc). El image-to-video de fal.ai es bastante bueno para esto

6. Audio - para escenas con diálogo genera voz en off con tts. Puedes asignar diferentes voces a diferentes personajes

7. Merge - combina video y audio, lip-sync opcional para personajes que hablan. Ffmpeg se encarga de esto

Stack Técnico

- next.js 16 con react 19 para la ui

- google gemini para generación de guiones y desglose de escenas

- fal.ai para generación de imágenes e image-to-video

- openai para algo de generación de texto

- ffmpeg webassembly para procesamiento de video en el navegador

Algunas Decisiones de Diseño

Persistencia de campaña - todo se guarda en localstorage automáticamente. Puedes cerrar el navegador y retomar después

Imágenes de referencia - esto fue crucial. Al generar la escena 3 puedes referenciar la imagen de la locación, retratos de personajes, escenas anteriores. La ia usa estas como anclas de estilo

Flujo por etapas - cada etapa produce un resultado que puedes revisar. ¿No te gustan las escenas? Regenera antes de avanzar. Te da control sin abrumarte con opciones

Resultados

El anuncio de globalpetsitter que me hubiera tomado un día completo ahora toma unos 30 minutos de trabajo activo (más tiempo de generación). Más importante aún, puedo iterar rápido. Probar diferentes tonos, intercambiar escenas, regenerar imágenes individuales sin empezar de cero

Qué Viene Después

Ad forge todavía está en bruto. Quiero agregar:

- selección de música de fondo

- más opciones de movimiento de cámara

- exportación directa a formatos de redes sociales (9:16 para tiktok/reels, 16:9 para youtube)

- plantillas para formatos de anuncios comunes

Por ahora está resolviendo mi problema: hacer anuncios en video para globalpetsitter sin que sea un sumidero de tiempo. A veces con eso basta :)

Stay Updated

Get notified about new posts on automation, productivity tips, indie hacking, and web3.

No spam, ever. Unsubscribe anytime.